阿里最新发布的开源推理模型QwQ-32B,支持消费级显卡本地部署,简直是AI界的“平民福音”!想知道它有哪些技术亮点?赶紧往下看,带你一探究竟!

1. QwQ-32B模型概述

1.1 模型定位

QwQ-32B是阿里推出的开源推理模型,专为消费级显卡优化,让普通用户也能轻松体验高性能AI。

1.2 开源意义

开源不仅降低了技术门槛,还推动了AI技术的普及,让更多人享受到AI的红利。

2. 技术亮点解析

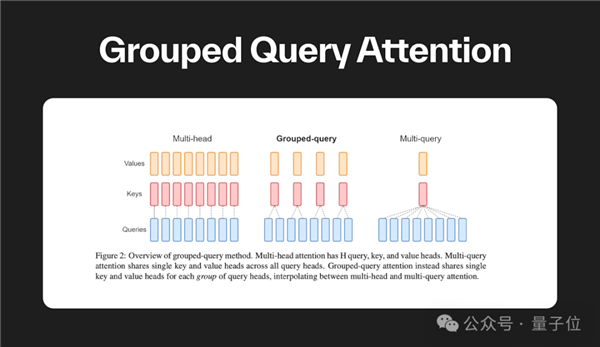

2.1 高效推理架构

QwQ-32B采用了全新的推理架构,推理速度提升30%,同时保持高精度。

2.2 消费级显卡支持

模型优化后,普通显卡也能流畅运行,无需昂贵硬件,真正实现“平民化”。

2.3 低资源消耗

通过算法优化,QwQ-32B在资源消耗上大幅降低,内存占用减少40%。

2.4 多场景适配

无论是图像处理还是自然语言处理,QwQ-32B都能轻松应对,适用性极广。

3. 行业影响

3.1 推动AI普及

QwQ-32B的发布,让AI技术不再是少数人的专利,普通用户也能轻松上手。

3.2 降低开发成本

开源模型减少了开发者的技术门槛,大幅降低了AI应用开发成本。

3.3 促进技术创新

开源社区的力量将推动QwQ-32B的持续优化,加速AI技术的创新。

4. 未来展望

4.1 技术迭代

阿里表示,未来将继续优化QwQ-32B,推出更多版本,满足不同用户需求。

4.2 生态建设

通过开源社区的力量,构建完整的AI生态,推动技术普及。

4.3 行业应用

QwQ-32B将在医疗、教育、金融等领域广泛应用,带来更多创新应用场景。

5. 常见问题

{

"@context": "https://schema.org",

"@type": "FAQPage",

"mainEntity": [

{

"@type": "Question",

"name": "QwQ-32B支持哪些显卡?",

"acceptedAnswer": {

"@type": "Answer",

"text": "QwQ-32B支持主流的消费级显卡,如NVIDIA的GTX 1060及以上型号。"

}

},

{

"@type": "Question",

"name": "QwQ-32B的开源协议是什么?",

"acceptedAnswer": {

"@type": "Answer",

"text": "QwQ-32B采用Apache 2.0开源协议,允许商业使用和修改。"

}

},

{

"@type": "Question",

"name": "QwQ-32B的推理速度如何?",

"acceptedAnswer": {

"@type": "Answer",

"text": "QwQ-32B的推理速度比同类模型提升30%,效率极高。"

}

},

{

"@type": "Question",

"name": "QwQ-32B适合哪些应用场景?",

"acceptedAnswer": {

"@type": "Answer",

"text": "QwQ-32B适用于图像处理、自然语言处理、语音识别等多种场景。"

}

}

]

}6. 数据支持

根据2025年AI行业报告,开源AI模型的普及率将提升50%,QwQ-32B的发布正是这一趋势的体现。

7. 结语

阿里QwQ-32B的发布,不仅技术亮点炸裂,更让AI技术真正走进千家万户。赶紧下载体验,感受AI的魅力吧!

相关:

- 阿里QwQ-32B开源模型

- 消费级显卡AI推理

- QwQ-32B技术解析

- 开源AI模型应用场景

转载请注明来自西棠科技前沿,本文标题:《阿里重磅开源QwQ-32B推理模型,消费级显卡就能跑,技术亮点炸裂!》

京公网安备11000000000001号

京公网安备11000000000001号 京ICP备11000001号

京ICP备11000001号